오늘은 드디어 ComfyUI로 고양이를 그려보자!

어떤 복잡한 노드를 만나더라도 이런 식의로 노드를 보며 해석할 수 있는 능력이 있으면 노드를 다루는 천재가 된다.

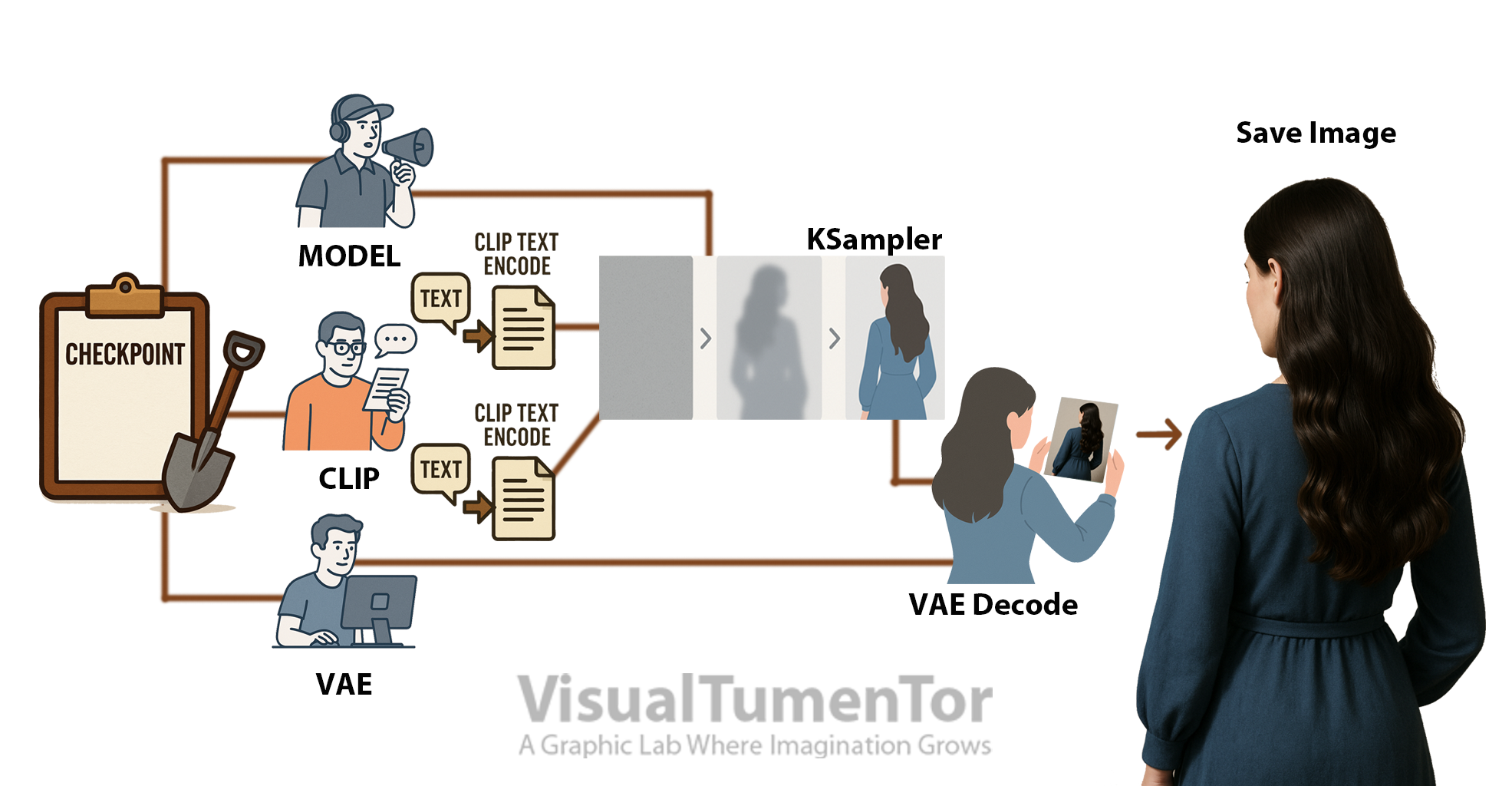

"모델을 불러오고 → 말로 그림을 설명하고 → 빈 캔버스를 준비한 뒤, AI가 노이즈를 지우며 그림을 그려가고 →마지막에 사람 눈에 보이게 바꿔서 → 저장하는 흐름이야. "

https://designmoney.tistory.com/59

ComfyUI 노드메칭

헐~ 뭐야이건 ...!! 복잡하기 짝이 없군 ComfyUI좀 배워보려했는데 이런것 까지 배워야 하나 싶지^^.이 그림을 이해하면 ComfyUI가 훨씬 이해하기 쉬워져.따라만 와바. 이 구조도는 "Latent Diffusion Model (L

designmoney.tistory.com

1. AI의 그림 실력 세팅

→ 먼저 ‘그림을 그릴 수 있는 능력’을 가진 AI 모델을 불러와. 이건 마치 화가에게 붓과 색감, 그림 스타일을 준비해주는 단계야.

모델 불러오기 → [Load Checkpoint] 노드

모델 출력: model → KSampler

CLIP 출력: clip → CLIP Text Encode 2개에 연결

VAE 출력: vae → VAE Decode에 연결

2.무슨 그림을 그릴지 말해줌

→ “귀여운 고양이(cute cat)”라고 텍스트로 말해줘.이 문장은 AI가 바로 알아듣지는 못하고, ‘이런 분위기의 그림이구나’ 하고 느낌을 숫자로 바꿔서 저장해.

[CLIP Text Encode (Prompt)] 노드

둘 다 CLIP 포트는 Load Checkpoint의 CLIP 출력에 연결됨

결과 Conditioning 출력은 KSampler의 positive, negative 포트에 연결

3.그림을 그릴 종이 만들기

→ 아무것도 없는 빈 캔버스를 준비해. AI는 이 빈 캔버스를 노이즈(지저분한 점들)로 채워놓고 여기서 점점 형태를 찾아가는 방식이야.

[Empty Latent Image] 노드

4.노이즈 속에서 고양이를 찾아감

→ 이제 AI가 본격적으로 작업 시작. 방금 받은 “귀여운 고양이”라는 숫자 지시와, 빈 캔버스를 가지고 노이즈를 하나하나 지워가며 ‘이게 고양이야’ 하는 형태를 만들어가.

[KSampler] 노드

model ← Load Checkpoint

positive ← "cute cat" 프롬프트

negative ← "text." 프롬프트

latent_image ← Empty Latent Image

출력 latent → VAE Decode로 전달

5.눈에 보이는 그림으로 완성

→ 이렇게 해서 만들어진 건 아직 숫자 덩어리야. 이걸 마지막에 진짜 그림처럼 보이도록 ‘풀어주는’ 과정을 거쳐야 우리가 보는 고양이 이미지가 완성돼.

[VAE Decode] 노드

samples ← KSampler에서 나온 latent 이미지

vae ← Load Checkpoint에서 나온 VAE

6.그림 저장하고 확인

→ 다 만들어진 고양이 그림은 파일로 저장되거나,

ComfyUI 화면에 바로 보여져.

[Save Image] 노드

노드 세팅이 끝났으면 이버튼을 클릭하면고양이 그리기 성공!!

너도 할 수 있어 도전해봐!!